AD-TECH

- リクルートデータ組織のブログをはじめました。※最新情報はRecruit Data Blogをご覧ください。

- Recruit Data Blogはこちら

こんにちは、プロダクトマネジャーのかねしょうです。

Google I/Oの2日目についてもさっそくご報告します!

※1日目の記事はこちら

2日目はGoogleの戦略を探るべく、今回のI/Oの中心にあるAssistantについてもろもろセッションに参加してみました。一言で言えば、Google Assistant Everywhereという感じでしょうか。

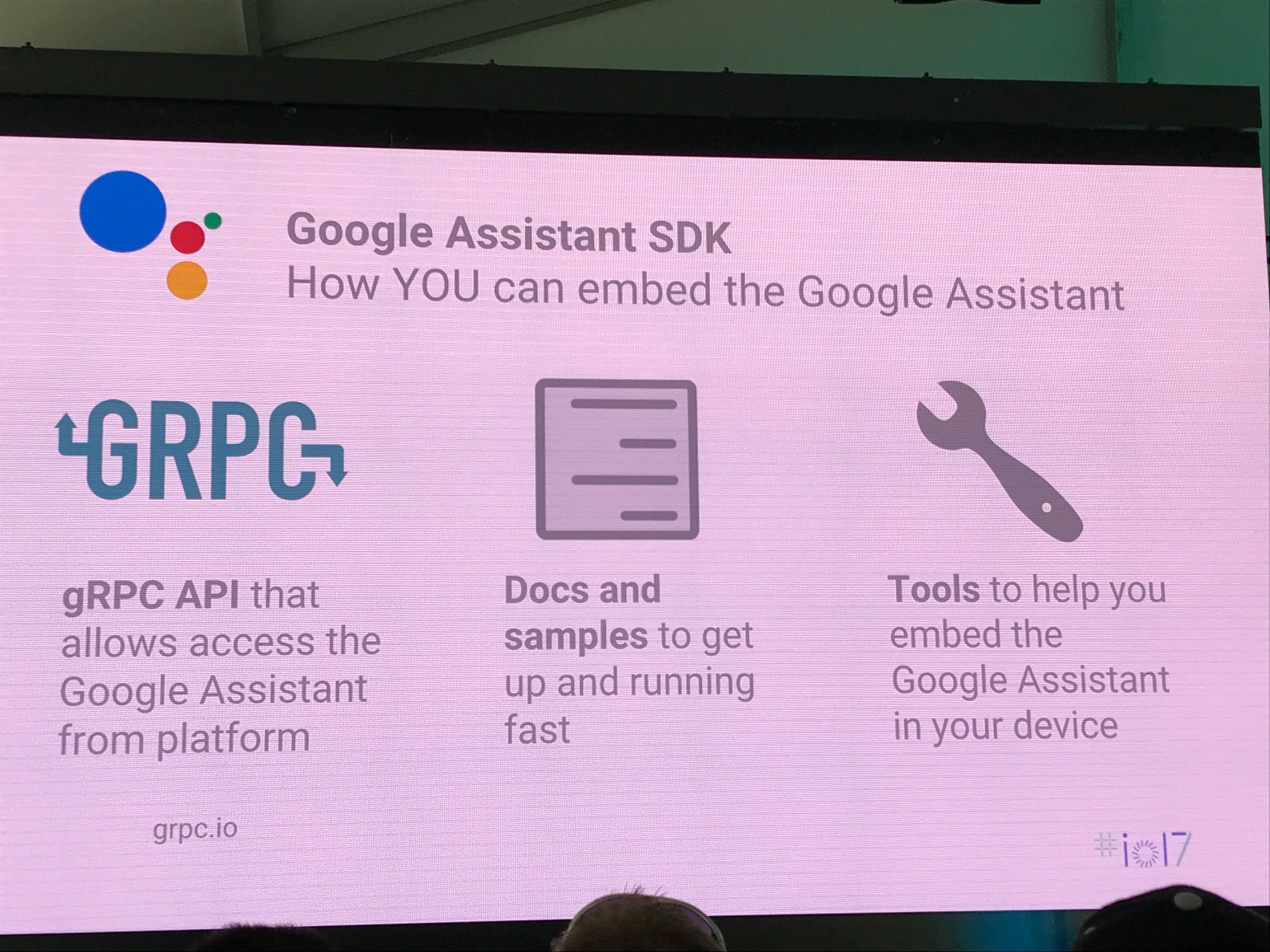

1日目のピチャイCEOのKeynoteはモバイルファーストからAIファーストへ、とメインビジョンが出たものの、AI & Machine Learning Everywhereはもともと最近のテクノロジーの潮流でした。今回のI/Oの中心テーマは実はIoTなどの中核としての人間とマシンとのインターフェースをGoogle Assistant & Actions on Googleというプラットフォームサービス群とSDKで取りに来た感じです。

Actions on GoogleというAssistantを通じて買い物やレストラン予約やイベント予約などを実現するサービスは、非常に強力なサービスで、スマホやHomeなどだけではなくAndroid TVやAndroid Autoといったカーナビ向けOS提供や家電領域におけるSDK提供を見ていると、例えば冷蔵庫にAssistantが付いて、そのまま足りないケチャップを買える世界がすぐそこに来ていることを感じられます。

近年のサーチエンジンなどの領域でホテル予約などが直接できる進化をしてきていたGoogleが、大きく次の一手を打ってきましたね。Homeだけであればそれほど普及しない見立てですが、Android TVの普及などを見ていると意外と広く利用可能デバイスは普及することになるだろうと見立てています。

Amazon Echoと違い、スマートフォンなどのGoogleの既存資産上で動くことがGoogleの本気度と第4次産業革命とされるIoTでも王者を取るという気迫を感じさせられるセッションが多いのが印象的でした。

また、それらを活用する開発環境もFirebaseやTensorFlowなど全方位でデベロッパー支援=自社インフラの普及に努めている感じです。

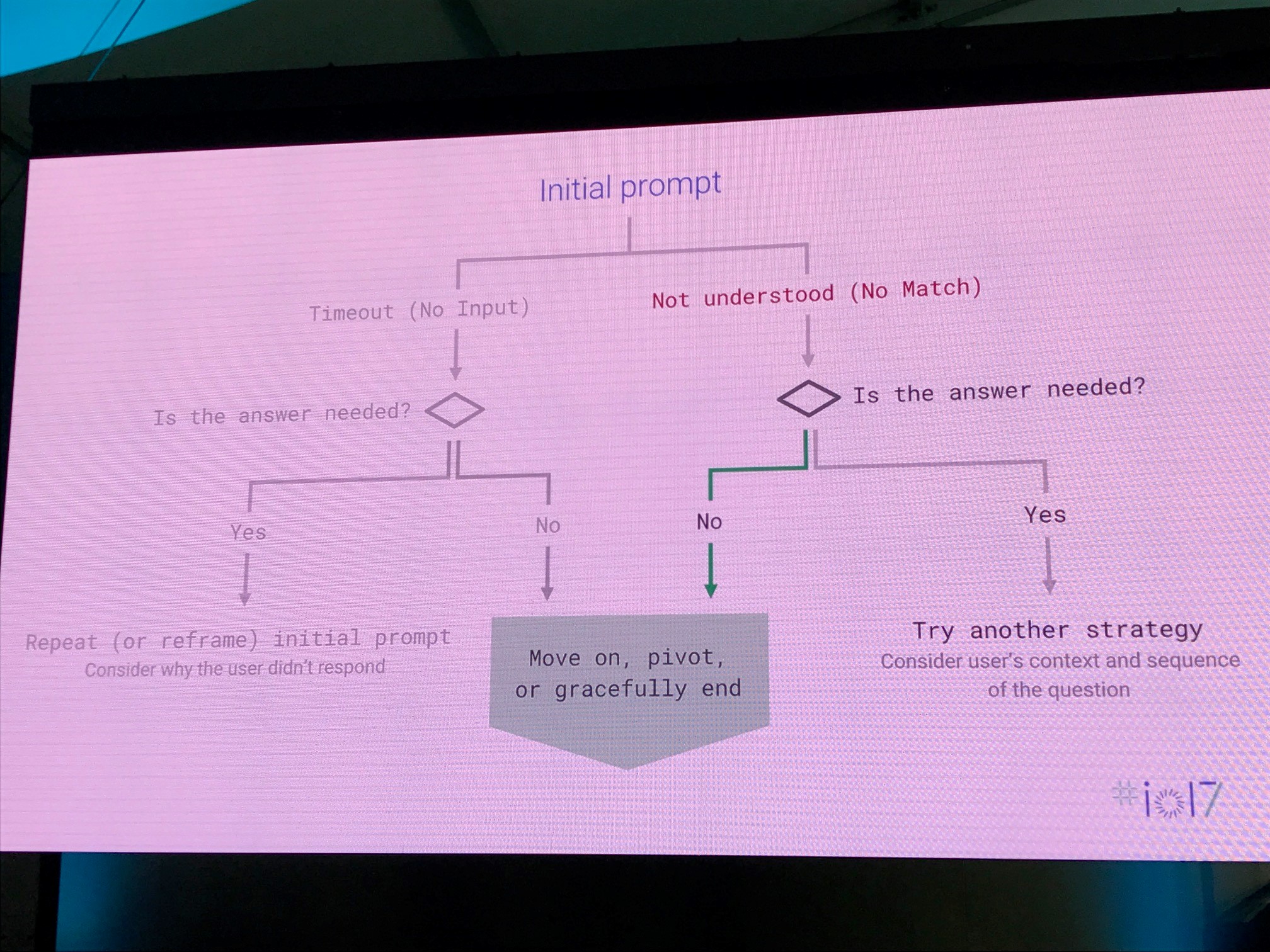

プロダクトマネジャーとしての視点としては、プラットフォーマーそのものを目指さない場合には、どのようにプラットフォーマーを活用するか、となりますが、今後の人とマシンのインターフェースが対話になるに従って対話設計力を磨くことがエクスペリエンス上必須とも理解しました。

テキストを読むだけという自然言語のみの対話だけではなく、ヴィジュアルインタラクション、オーディオインタラクション、ハプティックインタラクションといったモダリティをうまく組合せ、マシンとのコミュニケーションを最適化すること、そしてそのコミュニケーションの流れをより自然に、アクション=自己決定できるようにコミュニケーションシナリオを設計するスキルはこれから5年位のタームにおいてかなり価値ある仕事になると思います。

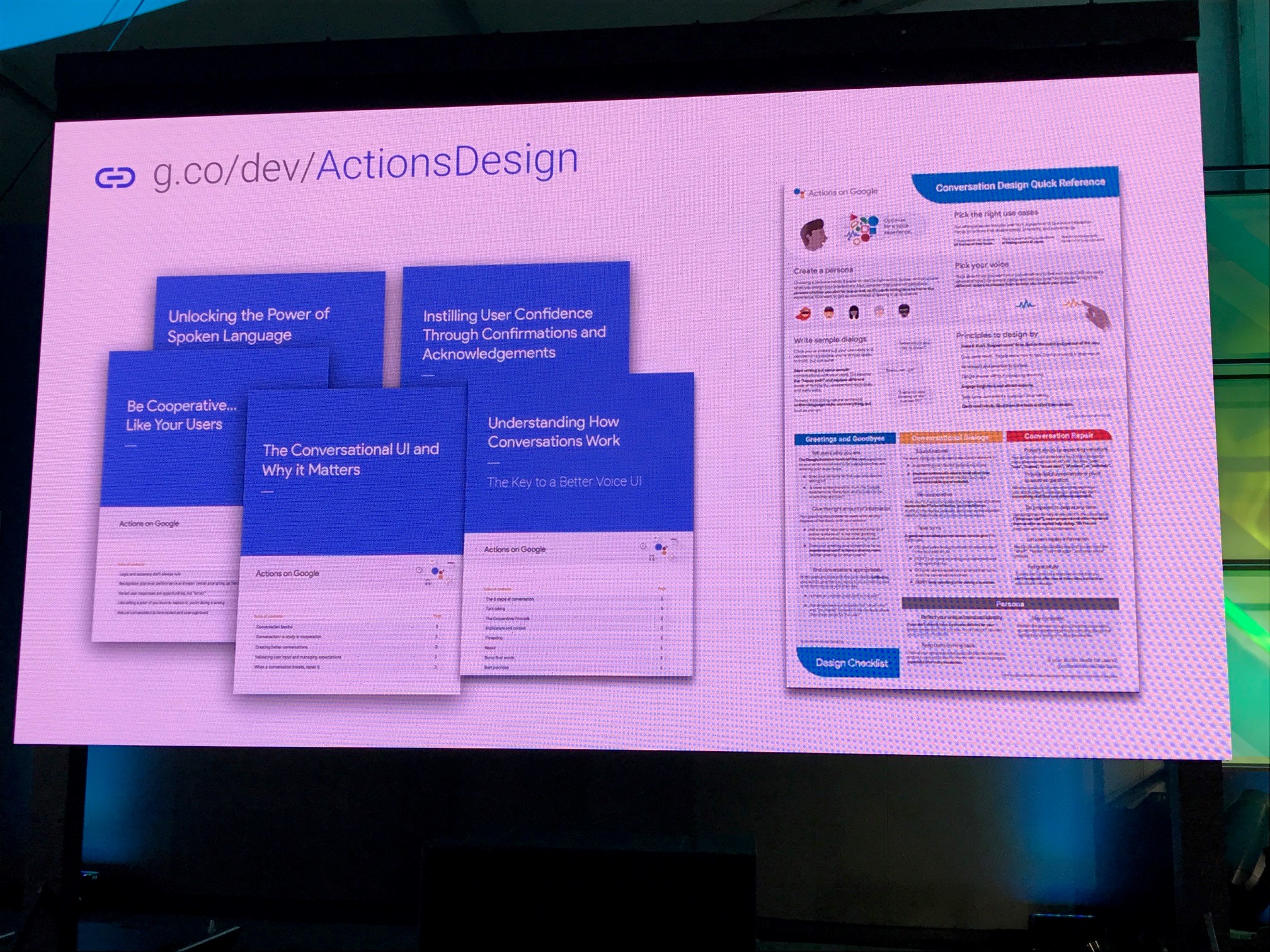

Googleでは心理学なども用いて色々と人間とマシンの対話の研究をしていて、それを元にActionDesignの標準手法についてもまとめて公開しているようなので興味のある方はぜひこちらの写真のURLにアクセスしてみてください。

ちなみに本日はセッションの間を少し抜けて、ちょうどRCOのエンジニアが実装のお手伝いに行っていることもあって、リクルートのAI研究機関であるRecruit Institute of Technologyにお邪魔してみました。

Mountain Viewという立地の通りの自然あふれる眺望のオフィスでした。

TAGS :

#出張ARCHIVE

- 月別記事リストを見る

-

- 2020年03月 (2)

- 2019年09月 (3)

- 2019年08月 (1)

- 2019年06月 (1)

- 2019年03月 (5)

- 2019年02月 (3)

- 2018年09月 (1)

- 2018年06月 (2)

- 2018年05月 (2)

- 2018年04月 (1)

- 2018年02月 (1)

- 2018年01月 (1)

- 2017年12月 (2)

- 2017年11月 (1)

- 2017年10月 (1)

- 2017年08月 (1)

- 2017年07月 (2)

- 2017年06月 (1)

- 2017年05月 (3)

- 2017年04月 (5)

- 2017年03月 (12)

- 2017年02月 (16)

- 2017年01月 (1)

- 2016年12月 (1)

- 2016年08月 (1)

- 2016年06月 (5)

- 2016年05月 (2)

- 2016年04月 (1)

- 2016年03月 (3)

- 2016年02月 (8)

- 2016年01月 (3)

- 2015年12月 (2)

- 2015年03月 (1)

- 2015年02月 (2)

- 2015年01月 (3)

- 2014年12月 (2)

- 2014年11月 (3)

- 2014年10月 (1)

- 2014年09月 (2)

- 2014年07月 (1)

- 2014年04月 (2)

- 2014年03月 (3)

- 2013年12月 (1)

- 2013年11月 (1)

- 2013年10月 (5)